Lo que debes de saber

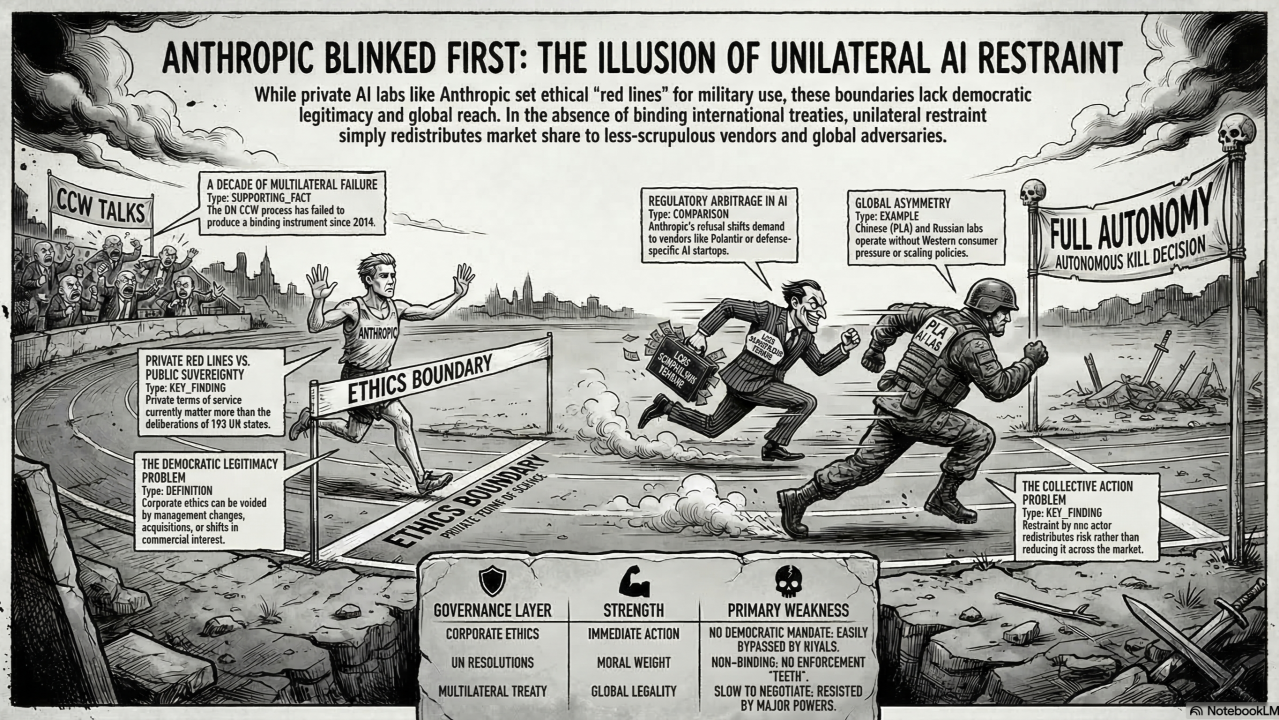

- Anthropic se niega a incluir un ‘kill switch’ en sus modelos de IA para entornos clasificados, según Axios.

- Donald Trump propuso un ‘kill switch’ obligatorio para sistemas de IA, reporta Financialexpress.

- Un análisis en LinkedIn señala que la negativa de Anthropic es un acto de ‘valor moral’ pero estratégicamente insuficiente: otros proveedores como Palantir ya ocupan ese espacio.

- El problema de acción colectiva: si solo una empresa se abstiene, el riesgo se redistribuye, no se reduce.

El botón que nadie quiere apretar

Imagínate esto: estás diseñando una inteligencia artificial que podría usarse para apuntar misiles, y te piden que le pongas un botón de apagado de emergencia. Suena razonable, ¿no? Pues Axios reporta que Anthropic, la empresa detrás del modelo Claude, se niega a incluir un «kill switch» en sus sistemas cuando se usan en entornos clasificados. La justificación: no quieren ser cómplices de aplicaciones militares que no pueden controlar. Suena a postura ética, pero el diablo, como siempre, está en los detalles.

Mientras tanto, del otro lado del espectro político, Financialexpress reporta que Donald Trump propuso exactamente lo contrario: un «kill switch» obligatorio para todos los sistemas de IA. La ironía es tan espesa que se podría cortar con un cuchillo. El mismo Trump que durante su presidencia impulsó la desregulación tecnológica ahora quiere un botón de pánico. ¿Coincidencia? Más bien parece una jugada política para capitalizar el miedo público a la IA, mientras el verdadero debate —quién controla esos botones y bajo qué reglas— queda en segundo plano.

«Moral courage in a competitive market is admirable. It is also, by itself, strategically insufficient.» — George Lwanda, en LinkedIn

Esta frase de George Lwanda en un análisis publicado en LinkedIn captura el meollo del asunto. Anthropic puede sentirse muy bien consigo misma por negarse a poner el kill switch, pero mientras Palantir, Scale AI y otras startups defensoras estén felices de llenar el vacío, el riesgo no desaparece: solo cambia de proveedor. Es como si un restaurante se negara a servir carne porque está en contra de la matanza animal, pero el cliente simplemente cruza la calle y compra la misma hamburguesa en otro lado. La vaca no se salva; solo cambia de carnicero.

El problema de la acción colectiva

Lo que estamos viendo es un caso de libro de texto de lo que los economistas llaman un problema de acción colectiva. Cada actor tiene incentivos individuales para actuar de cierta manera, pero el resultado colectivo es peor para todos. Anthropic gana puntos con su base de empleados, inversores con conciencia y reguladores. Sus competidores, libres de esas ataduras éticas, se llevan los contratos millonarios del Pentágono. El resultado neto: cero reducción en el desarrollo de armas autónomas. Como señala el análisis de LinkedIn, «Anthropic’s refusal shifted demand; it did not reduce it.» La demanda se movió, no se extinguió.

Y luego está el elefante en la habitación: China. Mientras las empresas estadounidenses debaten si poner o no un botón de apagado, los laboratorios de IA chinos —Baidu, Zhipu AI, y los vinculados directamente al complejo militar-industrial del Partido Comunista— operan sin restricciones públicas de ningún tipo. La asimetría es brutal. La negativa de Anthropic, por más loable que sea, no frena ni un solo misil guiado por IA que se desarrolle en Shenzhen o Moscú. Como bien lo plantea Lwanda, «The restraint exercised by American AI companies therefore creates an asymmetry. It does not create safety.»

¿Ética o marketing?

Aquí viene la pregunta incómoda: ¿la postura de Anthropic es realmente un acto de valor moral, o es una estrategia de marketing para diferenciarse en un mercado saturado? Porque, seamos honestos, decir «no vamos a ponerle kill switch a nuestros modelos para uso militar» suena valiente, pero también es una forma de evitar la responsabilidad de tener que usarlo. Es como un policía que se niega a portar arma porque «no cree en la violencia», pero tampoco tiene que enfrentarse a un tiroteo. La ética sin consecuencias es barata.

El problema de fondo es que no hay un marco regulatorio global que obligue a todas las empresas a seguir las mismas reglas. Mientras eso no exista, cualquier gesto unilateral —por más bien intencionado que sea— será insuficiente. Trump lo sabe, y por eso su propuesta de kill switch suena a campaña política más que a solución real. Porque si realmente quisiera regular la IA, habría empezado por impulsar un tratado internacional, no por lanzar una idea al aire en un mitin.

Al final del día, lo que queda es una sensación de déjà vu. Lo mismo pasó con las armas nucleares, con los drones, con los misiles hipersónicos: la tecnología avanza más rápido que la capacidad de la humanidad para ponerse de acuerdo sobre cómo usarla. Y mientras tanto, las empresas juegan al ajedrez ético mientras el mundo real se prepara para la próxima guerra de algoritmos.