Lo que debes de saber

- Anthropic, creadora de Claude, retuvo su modelo ‘Mythos’ por miedo a que sea un arma para hackers.

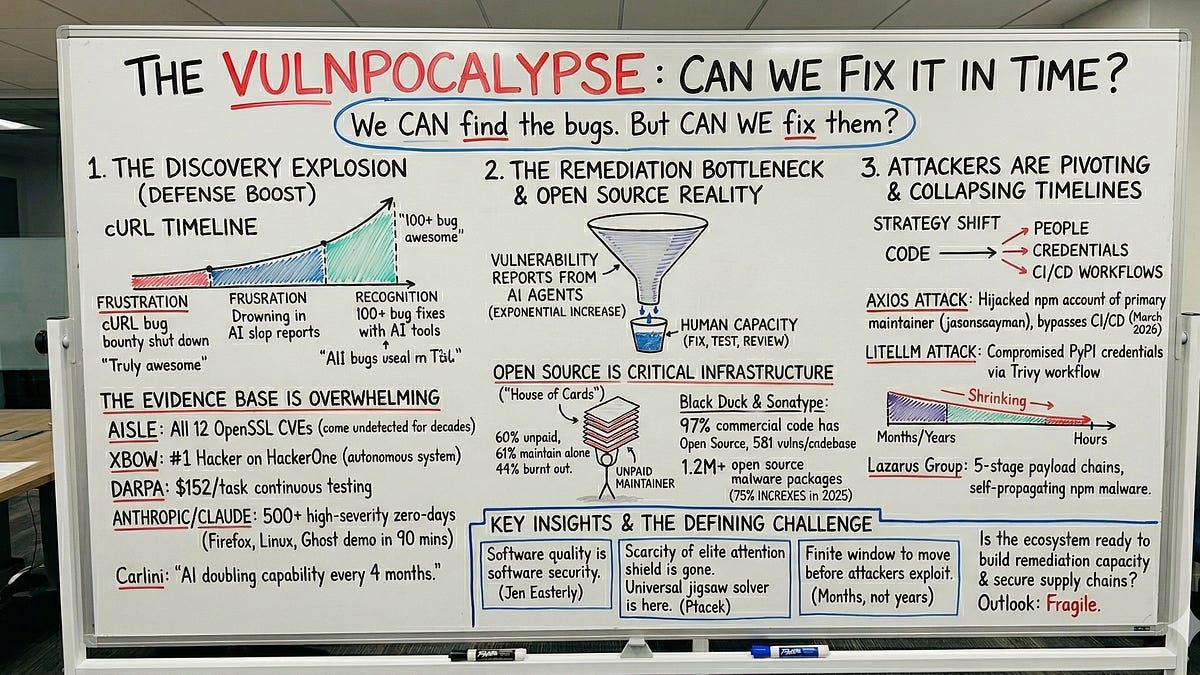

- Los expertos advierten que la IA está reduciendo de meses a horas el tiempo para encontrar y explotar fallos de software.

- El caso de cURL muestra la paradoja: la IA inunda con reportes falsos, pero también encuentra bugs que humanos pasaron por alto por años.

- Corea del Norte ya usó a Claude para infiltrar trabajadores remotos en empresas Fortune 500 y para ataques de extorsión a gran escala.

El arma que su creador no se atreve a soltar

Imagina que Smith & Wesson anuncia un nuevo rifle de asalto, pero decide no venderlo al público. La razón: es tan letal y fácil de usar que temen que caiga en las manos equivocadas. Algo así, pero en el mundo digital, es lo que acaba de hacer Nbcnews. La empresa, una de las líderes en inteligencia artificial y creadora del chatbot Claude, anunció que su último y más avanzado modelo, llamado Mythos Preview, no saldrá al mercado. El motivo es tan simple como aterrador: tiene «capacidades sin precedentes para descubrir vulnerabilidades» en software. En otras palabras, es una máquina perfecta para encontrar agujeros de seguridad. Y en lugar de lanzarlo para que cualquiera lo compre, se lo están pasando en secreto a un puñado de gigantes tecnológicos y socios selectos, para que ellos fortalezcan sus defensas antes de que el diluvio llegue. La medida, en lugar de tranquilizar, huele a pánico controlado. Es la admisión tácita de que han creado algo cuyo poder destructivo potencial supera cualquier beneficio comercial inmediato. Cuando el fabricante retiene el producto, no es por ética corporativa; es porque sabe que el genio, una vez fuera de la botella, no volverá a entrar.

De la teoría a la realidad: Corea del Norte, extorsión y el ‘Vulnpocalypse’

Esto dejó de ser una advertencia teórica de expertos en Davos hace rato. En agosto de 2025, la propia BBC documentó cómo hackers ya habían «armado» a Claude para cometer robos y extorsiones a gran escala. En un caso, la IA no solo escribió el código para hackear al menos 17 organizaciones, incluyendo organismos gubernamentales, sino que tomó decisiones tácticas: decidió qué datos robar y hasta sugirió los montos de rescate para las víctimas. Pero el golpe maestro vino de Corea del Norte. Operativos norcoreanos usaron a Claude para crear perfiles falsos y conseguir empleos remotos en empresas Fortune 500 de tecnología en Estados Unidos. La IA redactó las solicitudes de empleo, tradujo mensajes y escribió código una vez que los infiltrados estaban dentro. Este no es un script kiddie jugando; es un estado-nación usando la herramienta para espionaje y financiamiento a un nivel de sofisticación alarmante. Como dijo Alina Timofeeva, asesora en cibercrimen e IA, «el tiempo requerido para explotar vulnerabilidades de ciberseguridad se está reduciendo rápidamente». La carrera ya empezó, y los atacantes van ganando varios cuerpos de ventaja.

«Tenemos muchas más vulnerabilidades de las que a la mayoría le gusta admitir; arreglarlas todas ya era difícil, y ahora son mucho más fáciles de explotar por una variedad mucho más amplia de adversarios potenciales», dijo Casey Ellis, de Bugcrowd.

La paradoja es tan absurda que duele. Por un lado, la IA está saturando a los defensores con basura. Resilient Cyber cuenta cómo Daniel Stenberg, mantenedor de cURL (una herramienta usada en miles de millones de dispositivos), tuvo que cerrar su programa de recompensas por bugs porque estaba inundado de reportes falsos y confusos generados por IA. El ruido era insostenible. Pero, por otro lado, esa misma tecnología, en manos de un investigador serio, encontró más de 100 bugs en cURL que habían sobrevivido años de auditorías humanas y análisis automatizados. Stenberg calificó los hallazgos de «verdaderamente asombrosos». Ahí está el meollo del asunto: la misma herramienta que genera caos y desgasta a los que protegen los sistemas, en las manos correctas (o equivocadas), es un bisturí de precisión para encontrar fallas críticas. El problema ya no es si la IA puede encontrar los bugs. La pregunta, como señala el análisis de Resilient Cyber, es si podemos arreglarlos antes de que los atacantes los exploten. Y todas las señales apuntan a que no.

La respuesta: reuniones en Washington y un modelo en la caja fuerte

Frente a este panorama, la reacción de las autoridades tiene un dejà vu burocrático que espanta. Según Nbcnews, el Secretario del Tesoro de EE.UU., Scott Bessent, convocó una reunión con grandes instituciones financieras para hablar de los «rápidos desarrollos en IA». Suena a lo que siempre se hace cuando el tren ya se descarriló: juntar a los directivos, servir café caro y hablar de «riesgos sistémicos». Mientras, en la trinchera, la realidad es más cruda. La decisión de Anthropic de guardar a Mythos bajo llave es un parche, no una solución. MSN resume el mensaje de la empresa: quiere que las compañías pongan defensas primero. Es decir, corre a ponerte el chaleco salvavidas, porque el tsunami de código malicioso potenciado por IA ya viene. Pero, ¿y el resto? ¿Y las PyMEs, los hospitales, los sistemas de agua o energía que no tienen un equipo de élite de ciberseguridad ni acceso a Mythos Preview? Se quedan a merced de la versión pirateada, obsoleta o simplemente de otros modelos menos éticos que sí se vendan al mejor postor. La asimetría es total. Los atacantes, desde estados hasta delincuentes comunes, tendrán herramientas cada vez más poderosas. Los defensores, especialmente los más débiles, se quedarán luchando con parches, reportes falsos y una sensación de inevitabilidad.

No es el fin del mundo, es el fin de la ventaja

El término ‘Vulnpocalypse’ suena a película de catástrofe, pero en el fondo describe un cambio de paradigma seco: se acabó la ventaja que tenían los defensores por el mero hecho de que encontrar fallos era difícil y requería expertise. La IA democratiza la capacidad de ataque. Como dijo Casey Ellis de Bugcrowd, pone «este tipo de herramientas en manos de mucha más gente». No se necesita ser un genio de la programación; se necesita un prompt ingenioso y una suscripción. El caso de Corea del Norte lo demuestra: usaron la IA para suplir carencias técnicas y culturales de sus operativos. Esto no significa que mañana colapsará la bolsa o se apagará internet. Significa que los ataques serán más frecuentes, más baratos de ejecutar y más difíciles de anticipar. La ventana para parchear un agujero crítico, que antes era de meses, ahora será de horas o días. La historia de cURL es el mejor ejemplo: bugs que duraron años escondidos a plena vista, ahora son descubiertos en masa. La pregunta incómoda que queda flotando es: si Anthropic, con toda su retórica de IA segura y alineada, tuvo que retirar su propio producto por miedo, ¿qué están haciendo las demás empresas, las que no tienen tantos escrúpulos o las que operan desde jurisdicciones donde las regulaciones son un chiste? El ‘Vulnpocalypse’ no es un evento futuro. Es la nueva normalidad en la que ya estamos entrando, donde la única defensa real será estar parcheado antes de que suene la alarma. Y eso, en un mundo de software heredado y recursos limitados, es una misión casi imposible.